Escalar la Inteligencia Artificial: por qué hay que invertir primero en IA responsable

La IA responsable no solo es lo correcto desde el punto de vista moral, sino que también produce beneficios tangibles. Image: Unsplash/Gerd Altmann

Abhishek Gupta

Senior Responsible AI Leader & Expert, Boston Consulting Group (BCG), Founder and Principal Researcher, Montreal AI Ethics InstituteMantente al día:

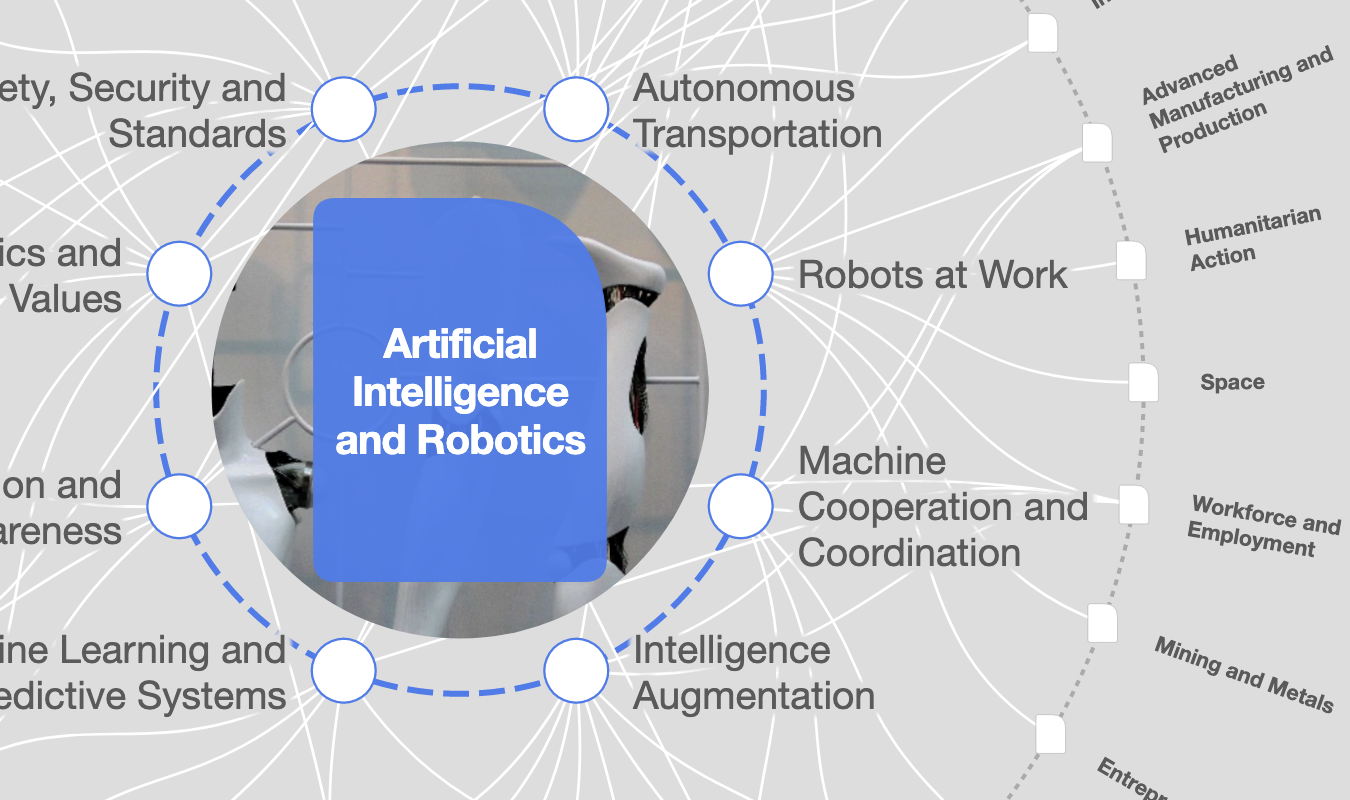

Inteligencia Artificial y Robótica

Listen to the article

- La inteligencia artificial puede ser transformadora para las empresas, pero el aumento del uso de la tecnología conduce inevitablemente a un mayor índice de fallos de los sistemas de IA.

- Sin embargo, las empresas deben invertir primero en IA responsable, que también produce beneficios al acelerar la innovación y ayudarles a ser más competitivas.

- Un enfoque de priorización que comience por las áreas de bajo esfuerzo y alto impacto en la IA responsable puede minimizar el riesgo y maximizar la inversión.

Los sistemas de inteligencia artificial (IA) están creando un valor empresarial transformador para las empresas que la integran en sus operaciones, productos y servicios, y en su estrategia corporativa. Pero, por desgracia, el aumento del uso de la tecnología conduce inevitablemente a un mayor índice de fallos de los sistemas de IA.

Si no se corrigen, estos fallos podrían perjudicar a las personas y a la sociedad y reducirían el rendimiento de la inversión en IA. Entonces, ¿qué pueden hacer las organizaciones?

La IA responsable -la práctica de diseñar, desarrollar y desplegar la IA con buena intención y con un impacto justo en la sociedad- no solo es lo moralmente correcto, sino que también produce beneficios tangibles al acelerar la innovación y ayudar a las organizaciones en la transición hacia el uso de la IA para ser más competitivas.

Sin embargo, los enfoques actuales provienen principalmente de empresas nativas de la IA y pueden no satisfacer las necesidades de las organizaciones no nativas de la IA, que tienen contextos, limitaciones, cultura y madurez de la IA diferentes.

Las empresas necesitan enfoques adaptados al propósito y a la medida para lograr un éxito sostenido en la práctica. A medida que un mayor número de organizaciones inician su andadura en la IA, se encuentran en la cúspide de tener que elegir entre invertir sus escasos recursos en la ampliación de sus esfuerzos de IA o canalizar las inversiones en la ampliación de la IA responsable de antemano.

Creemos que deberían hacer esto último para lograr un éxito sostenido y un mayor rendimiento de la inversión.

La ampliación de la IA conlleva más fracasos

Los sistemas modernos de IA son intrínsecamente estocásticos -ya que hacen uso de la aleatoriedad- y de naturaleza de caja negra, lo que significa que las entradas y operaciones del sistema no son visibles para el usuario u otra parte interesada.

Además, se construyen sobre complejas canalizaciones técnicas que ingieren, transforman y alimentan los datos en modelos de aprendizaje automático posteriores para lograr objetivos empresariales como la moderación automatizada de contenidos o la habilitación de la autoconducción.

Estas maravillas modernas son el resultado de la colaboración entre una diversidad de partes interesadas, tanto internas como externas, incluyendo científicos de datos, ingenieros de datos, diseñadores de UX/UI, científicos sociales, ingenieros de sistemas, ejecutivos de negocios y más.

Esta combinación de diversas aportaciones humanas y técnicas -de hecho, los sistemas de IA son sociotécnicos- introduce una plétora de nuevas superficies en las que pueden producirse fallos. En esta arquitectura sociotécnica tan entrelazada, es muy probable que los fallos pasen desapercibidos. Incluso cuando se detectan, suelen requerir una intensa labor de investigación para llegar a las causas fundamentales.

Por desgracia, el aumento de los fallos de la IA es un resultado natural de la ampliación de la tecnología. En pocas palabras, el despliegue de más sistemas de IA aumenta la probabilidad de que una empresa experimente un fallo.

Sin embargo, esto no debe disuadir a las empresas de perseguir el desarrollo y el uso de los sistemas de IA para alcanzar los objetivos empresariales. Por el contrario, las empresas solo tienen que tomar medidas proactivas para mitigar adecuadamente estos riesgos y proteger a los clientes y a la sociedad de daños no deseados.

La IA responsable puede ayudar a las empresas a minimizar el riesgo

La aplicación de un programa integral de IA responsable ayuda a las empresas a minimizar estos riesgos. Esto incluye las políticas, la gobernanza, los procesos, las herramientas y un cambio cultural más amplio para garantizar que los sistemas de IA se construyan de forma coherente con los valores y las normas de la organización.

Cuando se aplican correctamente, los programas de IA responsable reducen la frecuencia de los fallos al identificar y mitigar los problemas antes de que se despliegue el sistema. Y aunque los fallos pueden seguir produciéndose, su gravedad es menor, creando menos daño a las personas y a la sociedad.

Pero la creación de un programa integral de IA responsable lleva tiempo: tres años de media. Esto significa que las empresas no pueden esperar a que se produzca un fallo en el sistema para ponerse en marcha. De hecho, ni siquiera deberían esperar a estar preparadas para ampliar sus esfuerzos de IA. Por el contrario, deben empezar pronto y madurar la IA responsable antes que la IA.

Esto garantiza la existencia de los controles adecuados para minimizar el riesgo de escalar la IA. Y como beneficio adicional, también aumenta el valor empresarial de los sistemas de IA.

No es de extrañar, ya que muchos de los enfoques que son fundamentales para la IA responsable -como la participación de las partes interesadas o una interfaz de usuario y usuario bien pensada- también conducen a mejores productos que impulsan un mayor uso y adopción.

Cada organización necesita su propio enfoque de IA

El estado actual de la IA responsable procede en su mayoría de empresas nativas de la IA que han invertido mucho en enfoques que requieren recursos y apoyo del personal interno y una infraestructura técnica madura. A menudo operan con plazos de desarrollo de productos que se miden en años, lo que les da tiempo para una sólida participación de las múltiples partes interesadas.

Para las empresas más pequeñas o las que tienen limitaciones presupuestarias o que operan con un calendario ajustado -por ejemplo, las que han recibido su primer mandato de IA y necesitan demostrar resultados y rendimientos rápidamente- puede que no sea posible poner en marcha la IA responsable siguiendo el modelo de las empresas nativas de IA.

En cambio, necesitan un enfoque a medida que les permita dimensionar sus recursos (tanto humanos como técnicos) y garantizar que puedan mantenerse durante un largo periodo de tiempo para lograr un éxito duradero. La respuesta para cada empresa será, por tanto, única en función de su madurez técnica, sus matices culturales y sus limitaciones prácticas de recursos.

Hay algunos enfoques comunes que conducen al éxito. En primer lugar, aprovechar los procesos existentes de riesgo, cumplimiento y desarrollo de productos para simplificar la gestión del cambio y aprovechar los recursos existentes.

A continuación, aumentar la experiencia principalmente a través de la actualización de las competencias, complementada con contrataciones específicas y reflexionadas para minimizar la demanda de recursos mientras se avanza.

Por último, establezca un marco para evaluar el riesgo inherente de los productos de IA, que le permita concentrar los recursos en las áreas de mayor riesgo o con mayor probabilidad de fracaso.

Asignar eficazmente los recursos de la IA

Las compensaciones en la asignación de recursos son siempre una elección difícil, especialmente cuando se tiene un nuevo mandato y se le ha encomendado la tarea de generar ganancias tempranas para afirmar la confianza depositada en usted para esa inversión.

La IA responsable puede parecer desalentadora, con muchas subáreas que requieren atención -como la equidad, la transparencia, la responsabilidad, la seguridad, la fiabilidad, la privacidad, la seguridad, la gobernanza, etc.- que deben aplicarse en todas las etapas del ciclo de vida de la IA, incluidos el diseño, el desarrollo y la implantación.

Todo esto puede provocar una mala orientación de la atención y las inversiones o, lo que es peor, una parálisis en la acción. Sin embargo, las empresas no pueden ignorar los importantes deberes morales y éticos que conlleva el despliegue de un sistema de IA.

Por no mencionar que, por supuesto, también hay un fuerte incentivo comercial para minimizar los fallos del sistema. Las empresas pueden aumentar sus probabilidades de éxito teniendo en cuenta algunas consideraciones clave.

Ascender en la curva de madurez de la IA es un camino trillado que permite a las organizaciones obtener sistemáticamente beneficios de sus inversiones en IA, extrayendo valor de negocio al tiempo que se dimensionan correctamente las inversiones en recursos para impulsar ese viaje.

Los enfoques responsables de la IA desarrollados y difundidos por las organizaciones que están más avanzadas en ese camino llevan implícitas (y a menudo no declaradas) suposiciones de madurez de la infraestructura técnica subyacente y de disponibilidad de presupuestos y recursos humanos para poner en funcionamiento esos enfoques.

En cambio, empezar por identificar su etapa en el viaje de la IA y luego implementar las prácticas más adecuadas a su posición y capacidades mejora las posibilidades de éxito de la implementación.

Los empleados de una organización suelen firmar un código de conducta y afirmar su compromiso con la misión, la visión, el propósito y los valores de la organización. Además, hay normas implícitas no declaradas que están codificadas en la cultura y la práctica diaria de una organización.

Alinear el enfoque responsable de la IA con su misión

Ayudar a alinear su enfoque de implementación de la IA responsable con la misión, la visión, el propósito y los valores de su organización aumentará las posibilidades de éxito, por ejemplo, estableciendo un vínculo explícito entre la equidad y la inclusividad con los compromisos ambientales, sociales y de gobernanza más amplios de la organización.

Compartir las lecciones y las mejores prácticas que desarrolle con otros en posiciones similares no solo ayudará a su organización a obtener mejores resultados, sino que también reforzará el ecosistema más amplio para que las capacidades de IA responsable sean accesibles a más actores del ecosistema a medida que las organizaciones se mueven rápidamente para adoptar sistemas de IA.

Recuerde que ninguna empresa tiene todas las respuestas, ni siquiera las que están muy avanzadas en su viaje de IA responsable. La colaboración es una forma de obtener aún más de sus inversiones en recursos.

En última instancia, el éxito de la adopción de la IA, especialmente de forma responsable, requiere un orden correcto de las inversiones y los enfoques. Un enfoque de priorización que comience por las áreas de bajo esfuerzo y alto impacto en la IA responsable minimizará el riesgo y maximizará la inversión.

Al final, escalar la IA responsable antes de escalar la IA establece un camino pavimentado hacia el éxito. Si tiene en cuenta la madurez técnica de su organización, el contexto cultural y las limitaciones de recursos, se asegurará de experimentar un éxito sostenido y de crear una ventaja competitiva en el mercado, a la vez que vive el propósito y los valores de su organización.

No te pierdas ninguna actualización sobre este tema

Crea una cuenta gratuita y accede a tu colección personalizada de contenidos con nuestras últimas publicaciones y análisis.

Licencia y republicación

Los artículos del Foro Económico Mundial pueden volver a publicarse de acuerdo con la Licencia Pública Internacional Creative Commons Reconocimiento-NoComercial-SinObraDerivada 4.0, y de acuerdo con nuestras condiciones de uso.

Las opiniones expresadas en este artículo son las del autor y no del Foro Económico Mundial.

Temas relacionados:

La Agenda Semanal

Una actualización semanal de los temas más importantes de la agenda global

Puedes anular tu suscripción en cualquier momento utilizando el enlace que figura en nuestros correos electrónicos. Para obtener más información, consulta nuestro Política de privacidad.

Más sobre Inteligencia Artificial y RobóticaVer todo

Eugenio Zuccarelli

5 de abril de 2024

Ana Kreacic and Terry Stone

5 de abril de 2024

Victoria Masterson

2 de abril de 2024

James Fell

24 de marzo de 2024

Margot Edelman

24 de marzo de 2024